لا يتعلق الأمر بتصرفات متعمدة ضارة من قبل الموظفين، بل بالرغبة الطبيعية في تحسين الأداء والتغلب على ضغوط العمل. ومع ذلك، فإن الفجوة بين الابتكار التكنولوجي وسياسات الأمن المؤسسية تخلق منطقة رمادية تحتاج إلى فهم أعمق وإدارة أكثر فعالية.

الاستخدامات اليومية للذكاء الاصطناعي من قبل الموظفين

يلجأ الموظفون إلى أدوات الذكاء الاصطناعي لمجموعة متنوعة من المهام اليومية، مدفوعين بالرغبة في تحسين الإنتاجية وتقليل الوقت المستغرق في المهام الروتينية. هذه الاستخدامات، رغم فائدتها الواضحة، تحمل في طياتها مخاطر أمنية قد لا يدركها المستخدمون.

صياغة المراسلات والوثائق

يستخدم الموظفون أدوات مثل ChatGPT وClaude لصياغة رسائل البريد الإلكتروني والتقارير والعروض التقديمية. غالباً ما يقومون بنسخ ولصق محتوى داخلي في هذه الأدوات لتحسينه أو إعادة صياغته، دون إدراك أن هذه البيانات تُخزن على خوادم خارجية.

تحليل البيانات واستخراج الرؤى

يعتمد المحللون على أدوات الذكاء الاصطناعي لتحليل مجموعات البيانات الكبيرة واستخراج الاتجاهات والرؤى. قد يتضمن ذلك تحميل بيانات العملاء أو المبيعات أو الأداء إلى منصات تحليل غير معتمدة من قبل المؤسسة.

الترجمة ومعالجة اللغات

تُستخدم أدوات الترجمة المدعومة بالذكاء الاصطناعي لترجمة المستندات والمراسلات مع العملاء والشركاء الدوليين. هذا يعني أن المعلومات الحساسة قد تمر عبر خدمات ترجمة عامة غير آمنة.

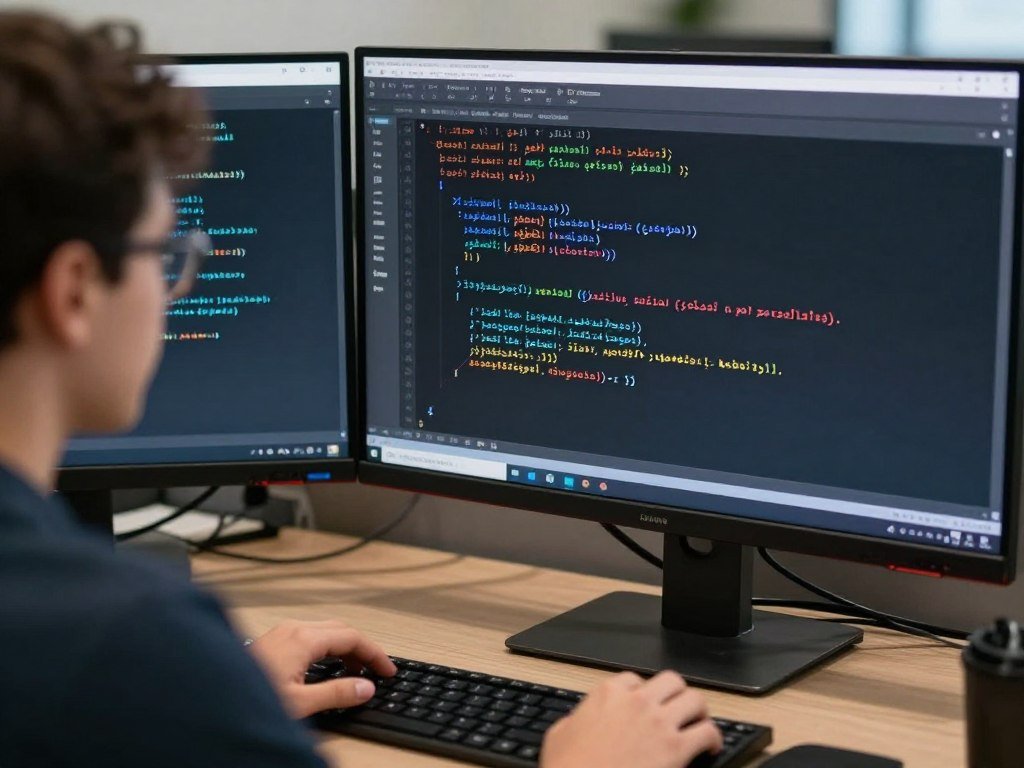

استكشاف الأخطاء وإصلاحها

يلجأ المطورون ومهندسو البرمجيات إلى أدوات مثل GitHub Copilot لاستكشاف الأخطاء وإصلاحها في الشفرات البرمجية. قد يتضمن ذلك مشاركة أجزاء من الشفرة المملوكة للشركة مع هذه الأدوات.

إنشاء المحتوى البصري

يستخدم المصممون والمسوقون أدوات توليد الصور والفيديو بالذكاء الاصطناعي لإنشاء محتوى بصري للحملات التسويقية والعروض التقديمية، مما قد يتضمن تحميل عناصر العلامة التجارية والصور المملوكة للشركة.

تلخيص المستندات الطويلة

يعتمد الموظفون على أدوات الذكاء الاصطناعي لتلخيص التقارير الطويلة والمستندات القانونية والبحوث، مما يوفر الوقت ولكن يتطلب مشاركة المحتوى الكامل مع هذه الأدوات.

“يستخدم 80% من الموظفين أدوات الذكاء الاصطناعي العامة في مكان العمل، بينما تمتلك 25% فقط من المؤسسات سياسات واضحة تنظم هذا الاستخدام.”

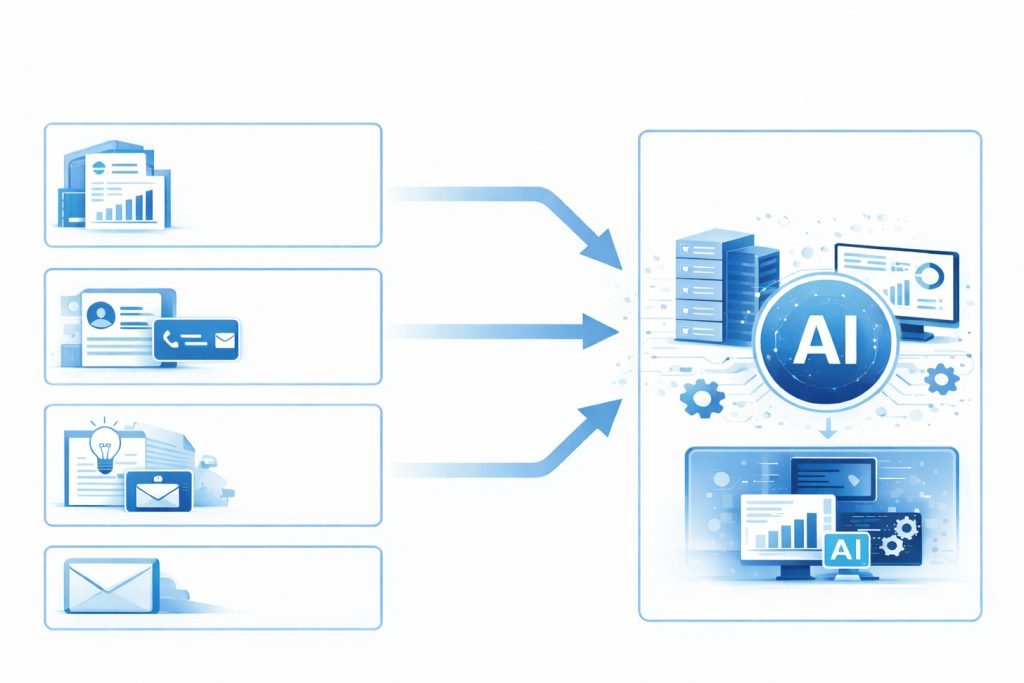

كيف تتعرض البيانات الحساسة للخطر؟

عندما يستخدم الموظفون أدوات الذكاء الاصطناعي العامة، فإنهم يعرضون بيانات المؤسسة لمخاطر متعددة قد لا يدركونها. تعمل معظم هذه الأدوات على نموذج “البيانات كمقابل للخدمة”، حيث تستخدم المدخلات لتحسين نماذجها وخوارزمياتها.

أنواع البيانات المعرضة للخطر

- استراتيجيات الأعمال: خطط التوسع، استراتيجيات التسويق، وتوقعات المبيعات التي قد يتم إدخالها في أدوات الذكاء الاصطناعي لتحليلها أو تلخيصها.

- معلومات العملاء الشخصية: بيانات الاتصال، سجلات المعاملات، وتفضيلات العملاء التي قد تُستخدم في تحليل السوق أو خدمة العملاء.

- الملكية الفكرية: الشفرات البرمجية، التصاميم، وبراءات الاختراع قيد التطوير التي قد تُشارك مع أدوات البرمجة بمساعدة الذكاء الاصطناعي.

- المراسلات الداخلية: رسائل البريد الإلكتروني والمذكرات التي قد تُنسخ وتُلصق في أدوات صياغة المحتوى.

آليات تسرب البيانات

التدريب على البيانات المقدمة

تستخدم العديد من خدمات الذكاء الاصطناعي البيانات المدخلة من المستخدمين لتدريب نماذجها وتحسينها. هذا يعني أن المعلومات السرية التي يدخلها الموظفون قد تصبح جزءًا من قاعدة بيانات التدريب وتظهر لاحقًا في إجابات مقدمة لمستخدمين آخرين.

التخزين غير المصرح به

تحتفظ معظم أدوات الذكاء الاصطناعي بسجل للمحادثات والمدخلات لفترات طويلة، وقد لا تكون هذه البيانات مشفرة أو محمية بشكل كافٍ. هذا يخلق نقاط ضعف إضافية يمكن استغلالها في حالة اختراق مزود الخدمة.

مشاركة البيانات مع أطراف ثالثة

قد تشارك بعض مزودي خدمات الذكاء الاصطناعي البيانات مع شركاء أو مزودي خدمات آخرين لأغراض التحليل أو تحسين الخدمة، مما يوسع دائرة الوصول إلى المعلومات الحساسة.

مثال واقعي: تسرب غير مقصود

قام محلل مالي في شركة استثمارية بنسخ ولصق بيانات مالية ربع سنوية غير معلنة في ChatGPT لمساعدته في صياغة تقرير تحليلي. بعد أسابيع، اكتشف أن تفاصيل مشابهة ظهرت في إجابة قدمها النظام لمستخدم آخر يبحث عن معلومات حول أداء الشركات في نفس القطاع.

لماذا لا تلاحظ فرق الأمن هذا السلوك؟

رغم المخاطر الواضحة، غالبًا ما يظل استخدام الموظفين لأدوات الذكاء الاصطناعي خارج نطاق رصد فرق الأمن السيبراني. هناك عدة أسباب تجعل هذا النوع من النشاط يمر دون ملاحظة:

التحديات التقنية في الرصد

- حركة مرور مشفرة: معظم أدوات الذكاء الاصطناعي تستخدم اتصالات HTTPS مشفرة، مما يجعل من الصعب على أنظمة مراقبة الشبكة تحليل المحتوى المتبادل.

- تشابه مع حركة المرور العادية: يبدو استخدام أدوات الذكاء الاصطناعي مشابهًا لتصفح الويب العادي، مما يجعل من الصعب تمييزه عن الأنشطة المشروعة الأخرى.

- تعدد المنصات: مع ظهور مئات الأدوات والخدمات الجديدة المدعومة بالذكاء الاصطناعي شهريًا، يصعب على فرق الأمن تحديث قوائم المراقبة باستمرار.

الفجوات في السياسات والإجراءات

سياسات غير محدثة

لم تقم العديد من المؤسسات بتحديث سياسات الأمن السيبراني لديها لتشمل استخدام أدوات الذكاء الاصطناعي بشكل محدد، مما يترك منطقة رمادية يستغلها الموظفون.

نقص الوعي بالمخاطر

غالبًا ما تفتقر فرق الأمن نفسها إلى الفهم الكامل لكيفية عمل أدوات الذكاء الاصطناعي ونماذج أعمالها وآليات جمع البيانات الخاصة بها.

التركيز على التهديدات التقليدية

تميل فرق الأمن إلى التركيز على التهديدات التقليدية مثل البرمجيات الخبيثة والتصيد الاحتيالي، بينما تظل مخاطر تسرب البيانات عبر الأدوات المشروعة في مرتبة أقل من الأولويات.

تعرف على مخاطر الذكاء الاصطناعي في مؤسستك

اكتشف مخاطر استخدام الذكاء الاصطناعي في بيئة العمل واكتشف كيف يمكنك حماية بيانات مؤسستك بفعالية.

النية الحسنة مقابل المخاطر غير المقصودة

من المهم التمييز بين الاستخدام الضار المتعمد للذكاء الاصطناعي والاستخدام حسن النية الذي قد يؤدي إلى مخاطر غير مقصودة. في معظم الحالات، لا يتصرف الموظفون بنية سيئة، بل يسعون إلى تحسين أدائهم وإنتاجيتهم.

دوافع استخدام الموظفين للذكاء الاصطناعي

- تحسين الإنتاجية: الرغبة في إنجاز المهام بشكل أسرع وبجودة أعلى.

- التغلب على تحديات العمل: استخدام الذكاء الاصطناعي للمساعدة في المهام الصعبة أو غير المألوفة.

- ضغوط المواعيد النهائية: اللجوء إلى أدوات تسريع العمل عند مواجهة مواعيد نهائية ضاغطة.

- سد فجوات المهارات: الاستعانة بالذكاء الاصطناعي للتعويض عن نقص الخبرة في مجالات معينة.

الفرق بين إساءة الاستخدام المتعمدة والمخاطر غير المقصودة

| جانب المقارنة | الاستخدام حسن النية | إساءة الاستخدام المتعمدة |

| الدافع | تحسين الإنتاجية وجودة العمل | سرقة البيانات أو إلحاق الضرر بالمؤسسة |

| الوعي بالمخاطر | منخفض أو معدوم | مرتفع ومقصود |

| نوع البيانات المشاركة | متنوعة وغير منتقاة بعناية | مستهدفة وذات قيمة عالية |

| نمط الاستخدام | منتظم وخلال ساعات العمل | غير منتظم وقد يحدث خارج ساعات العمل |

| استراتيجية المعالجة | التوعية والتدريب وتوفير بدائل آمنة | الرصد والكشف والإجراءات التأديبية |

نصيحة للمؤسسات

تبني نهج “افترض حسن النية” عند التعامل مع استخدام الموظفين للذكاء الاصطناعي. ركز على التوعية وتوفير البدائل الآمنة بدلاً من اتخاذ إجراءات عقابية قد تدفع الاستخدام إلى الخفاء.

كيف تتعامل المؤسسات المتقدمة مع هذا التحدي؟

بدأت المؤسسات الرائدة في مجال الأمن السيبراني بتطوير استراتيجيات متكاملة للتعامل مع تحديات استخدام الذكاء الاصطناعي في بيئة العمل. تتبنى هذه المؤسسات نهجًا متوازنًا يسمح بالاستفادة من فوائد الذكاء الاصطناعي مع تقليل المخاطر المرتبطة به.

النهج الاستراتيجي للتعامل مع الذكاء الاصطناعي في بيئة العمل

الاعتراف والتقييم

تبدأ المؤسسات المتقدمة بالاعتراف بأن استخدام الذكاء الاصطناعي أصبح واقعًا لا يمكن تجاهله. تقوم هذه المؤسسات بإجراء تقييم شامل لكيفية استخدام الموظفين لأدوات الذكاء الاصطناعي وأنواع البيانات التي يشاركونها.

تطوير سياسات محددة

تقوم المؤسسات بتطوير سياسات واضحة تحدد الاستخدامات المسموح بها وغير المسموح بها للذكاء الاصطناعي، مع التركيز على أنواع البيانات التي يمكن مشاركتها وتلك التي يجب حمايتها.

توفير بدائل آمنة

بدلاً من منع استخدام الذكاء الاصطناعي تمامًا، توفر المؤسسات المتقدمة بدائل آمنة ومعتمدة داخليًا تلبي احتياجات الموظفين مع الحفاظ على أمن البيانات.

أمثلة على الحلول المتوازنة

منصات الذكاء الاصطناعي الخاصة

تستثمر بعض المؤسسات في نشر إصدارات خاصة من أدوات الذكاء الاصطناعي داخل بيئتها، مثل نماذج ChatGPT المخصصة التي تعمل على البنية التحتية الخاصة بالمؤسسة، مما يضمن بقاء البيانات داخل حدود المؤسسة.

أنظمة تصنيف البيانات

تطبق المؤسسات أنظمة لتصنيف البيانات تساعد الموظفين على فهم أي أنواع المعلومات يمكن مشاركتها مع أدوات الذكاء الاصطناعي الخارجية وأيها يجب أن تبقى محمية.

برامج التوعية المستمرة

تنفذ المؤسسات برامج توعية مستمرة تثقف الموظفين حول مخاطر مشاركة البيانات مع أدوات الذكاء الاصطناعي وكيفية استخدامها بشكل آمن.

الرصد الذكي

تستخدم المؤسسات المتقدمة أنظمة رصد ذكية تستطيع تحديد أنماط استخدام الذكاء الاصطناعي غير الآمن دون التدخل في خصوصية الموظفين أو إعاقة إنتاجيتهم.

“الهدف ليس منع استخدام الذكاء الاصطناعي، بل تمكين الموظفين من استخدامه بطريقة آمنة ومسؤولة تحمي بيانات المؤسسة وخصوصية العملاء.”

توصيات عملية لإدارة استخدام الذكاء الاصطناعي في بيئة العمل

لتحقيق التوازن بين الاستفادة من إمكانيات الذكاء الاصطناعي وحماية أمن المعلومات، يمكن للمؤسسات اتباع مجموعة من التوصيات العملية التي تناسب مختلف الأحجام والقطاعات.

على مستوى السياسات

- تطوير سياسة واضحة: صياغة سياسة محددة لاستخدام الذكاء الاصطناعي تحدد الأدوات المعتمدة وأنواع البيانات التي يمكن مشاركتها.

- تصنيف البيانات: تطبيق نظام لتصنيف البيانات يساعد الموظفين على فهم مستويات حساسية المعلومات المختلفة.

- مراجعة اتفاقيات الخدمة: تقييم شروط الخدمة لأدوات الذكاء الاصطناعي المختلفة لفهم كيفية تعاملها مع البيانات المدخلة.

على مستوى التوعية والتدريب

- برامج توعية منتظمة: تنفيذ برامج توعية دورية حول مخاطر مشاركة البيانات مع أدوات الذكاء الاصطناعي.

- أمثلة واقعية: استخدام أمثلة واقعية لتوضيح كيف يمكن أن تؤدي المشاركة غير المقصودة للبيانات إلى مخاطر أمنية.

- إرشادات عملية: توفير إرشادات سهلة الفهم حول كيفية استخدام أدوات الذكاء الاصطناعي بأمان.

على المستوى التقني

- توفير بدائل آمنة: نشر إصدارات خاصة من أدوات الذكاء الاصطناعي داخل بيئة المؤسسة.

- تقنيات الرصد الذكي: استخدام أدوات تحليل حركة الشبكة للكشف عن استخدام أدوات الذكاء الاصطناعي غير المعتمدة.

- تقنيات إخفاء الهوية: توفير أدوات تساعد الموظفين على إزالة المعلومات الحساسة قبل مشاركة البيانات مع أدوات الذكاء الاصطناعي.

خطوات عملية للتنفيذ

- تقييم الوضع الحالي: إجراء مسح لفهم كيفية استخدام الموظفين لأدوات الذكاء الاصطناعي حاليًا.

- تحديد الاحتياجات: فهم الأسباب التي تدفع الموظفين لاستخدام هذه الأدوات وتحديد الاحتياجات الحقيقية.

- تطوير الحلول: تصميم حلول تلبي احتياجات الموظفين مع الحفاظ على أمن البيانات.

- التنفيذ التدريجي: تطبيق الحلول بشكل تدريجي مع جمع التغذية الراجعة وإجراء التعديلات اللازمة.

- المراقبة والتحسين: مراقبة فعالية الإجراءات المتخذة وتحسينها باستمرار.

تحذير هام

تجنب اتخاذ نهج “المنع الشامل” لاستخدام الذكاء الاصطناعي، فقد يؤدي ذلك إلى دفع الموظفين لاستخدام هذه الأدوات سرًا، مما يزيد من المخاطر بدلاً من تقليلها. بدلاً من ذلك، ركز على توفير بدائل آمنة وتثقيف الموظفين حول الاستخدام المسؤول.

هل تحتاج إلى مساعدة في تطوير استراتيجية آمنة للذكاء الاصطناعي؟

احصل على أحدث النصائح والإرشادات حول كيفية تحقيق التوازن بين الابتكار والأمن في عصر الذكاء الاصطناعي.

خلاصة: نحو استخدام آمن ومسؤول للذكاء الاصطناعي في العمل

استخدام الموظفين للذكاء الاصطناعي في بيئة العمل أصبح واقعًا لا يمكن تجاهله أو منعه بشكل كامل. المفتاح لإدارة هذا التحدي يكمن في تبني نهج متوازن يعترف بالفوائد التي تقدمها هذه التقنيات مع معالجة المخاطر المرتبطة بها بشكل استباقي.

من خلال تطوير سياسات واضحة، وتوفير التدريب المناسب، وتقديم بدائل آمنة، يمكن للمؤسسات تمكين موظفيها من الاستفادة من إمكانيات الذكاء الاصطناعي مع حماية بياناتها الحساسة. الهدف النهائي ليس منع الابتكار، بل توجيهه في مسارات آمنة تعزز الإنتاجية وتحمي المصالح الأساسية للمؤسسة.

في عالم يتطور فيه الذكاء الاصطناعي بوتيرة متسارعة، يجب أن تتطور معه ممارسات الأمن السيبراني لتوفير الحماية اللازمة دون إعاقة التقدم التكنولوجي. المؤسسات التي ستنجح في المستقبل هي تلك التي ستتمكن من تحقيق هذا التوازن الدقيق بين الابتكار والأمن.

“الأمن السيبراني في عصر الذكاء الاصطناعي لا يتعلق بمنع التكنولوجيا، بل بتمكين استخدامها بطريقة مسؤولة تحمي مصالح جميع الأطراف المعنية.”

للمزيد من المعلومات حول أفضل الممارسات في مجال الأمن السيبراني والذكاء الاصطناعي، يمكنكم زيارة قسم الأمن السيبراني في موقعنا.

الأسئلة الشائعة حول استخدام الذكاء الاصطناعي في بيئة العمل

هل يجب منع الموظفين تمامًا من استخدام أدوات الذكاء الاصطناعي العامة؟

المنع الكامل قد يكون غير عملي وقد يؤدي إلى استخدام هذه الأدوات سرًا، مما يزيد من المخاطر. النهج الأكثر فعالية هو توفير بدائل آمنة، ووضع إرشادات واضحة حول أنواع البيانات التي يمكن مشاركتها، وتثقيف الموظفين حول المخاطر المحتملة.

ما هي أنواع البيانات التي يجب عدم مشاركتها مطلقًا مع أدوات الذكاء الاصطناعي العامة؟

يجب عدم مشاركة البيانات الشخصية للعملاء، والمعلومات المالية السرية، والملكية الفكرية، والاستراتيجيات التنافسية، والمعلومات الداخلية الحساسة مع أدوات الذكاء الاصطناعي العامة. يجب أن تكون هناك سياسة واضحة تحدد تصنيفات البيانات وقواعد مشاركتها.

كيف يمكن للمؤسسات الصغيرة التي لا تملك موارد كبيرة التعامل مع هذا التحدي؟

يمكن للمؤسسات الصغيرة البدء بخطوات بسيطة مثل وضع سياسة أساسية لاستخدام الذكاء الاصطناعي، وتوفير تدريب أساسي للموظفين، واختيار أدوات ذكاء اصطناعي تقدم ضمانات أفضل لخصوصية البيانات. كما يمكنها الاستفادة من الموارد المجانية المتاحة من المنظمات المتخصصة في الأمن السيبراني.

هل هناك أدوات ذكاء اصطناعي أكثر أمانًا من غيرها؟

نعم، بعض مزودي خدمات الذكاء الاصطناعي يقدمون خيارات أفضل لحماية الخصوصية، مثل عدم استخدام البيانات المدخلة لتدريب النماذج، أو توفير إصدارات خاصة يمكن نشرها داخل بيئة المؤسسة. من المهم مراجعة شروط الخدمة وسياسات الخصوصية قبل اعتماد أي أداة.

كيف يمكن قياس فعالية سياسات استخدام الذكاء الاصطناعي في المؤسسة؟

يمكن قياس الفعالية من خلال مؤشرات مثل: مستوى الالتزام بالسياسات، عدد حوادث تسرب البيانات المرتبطة بالذكاء الاصطناعي، مستوى وعي الموظفين بالمخاطر (يمكن قياسه من خلال استطلاعات)، ومدى استخدام البدائل الآمنة المقدمة من المؤسسة. المراجعة الدورية لهذه المؤشرات تساعد في تحسين السياسات والإجراءات.